共计 330 个字符,预计需要花费 1 分钟才能阅读完成。

用本地 Qwen+Deepseek 大模型写的,自己也修改了一部分

想用来测试一下离线模型的效率~~~~~~

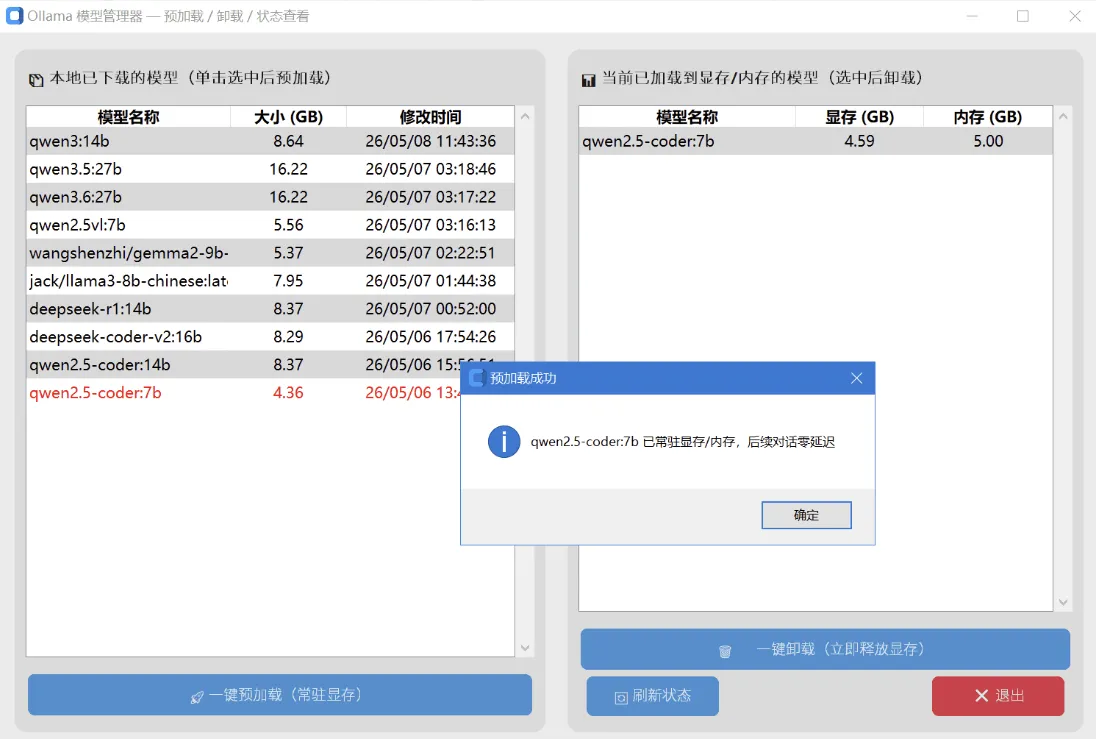

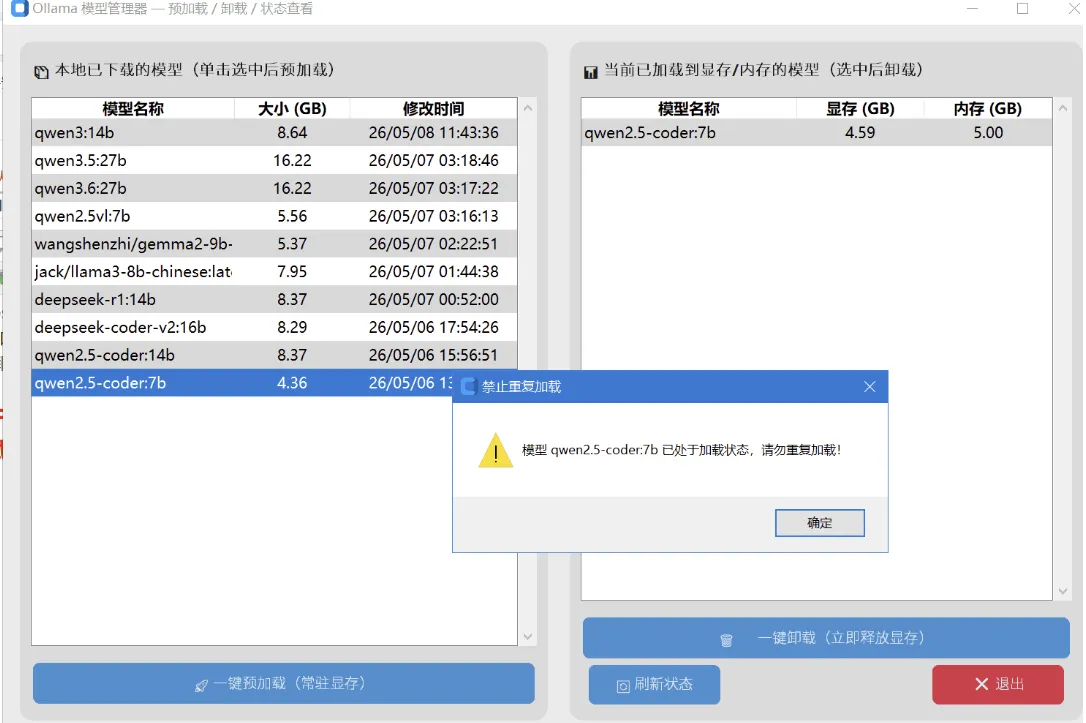

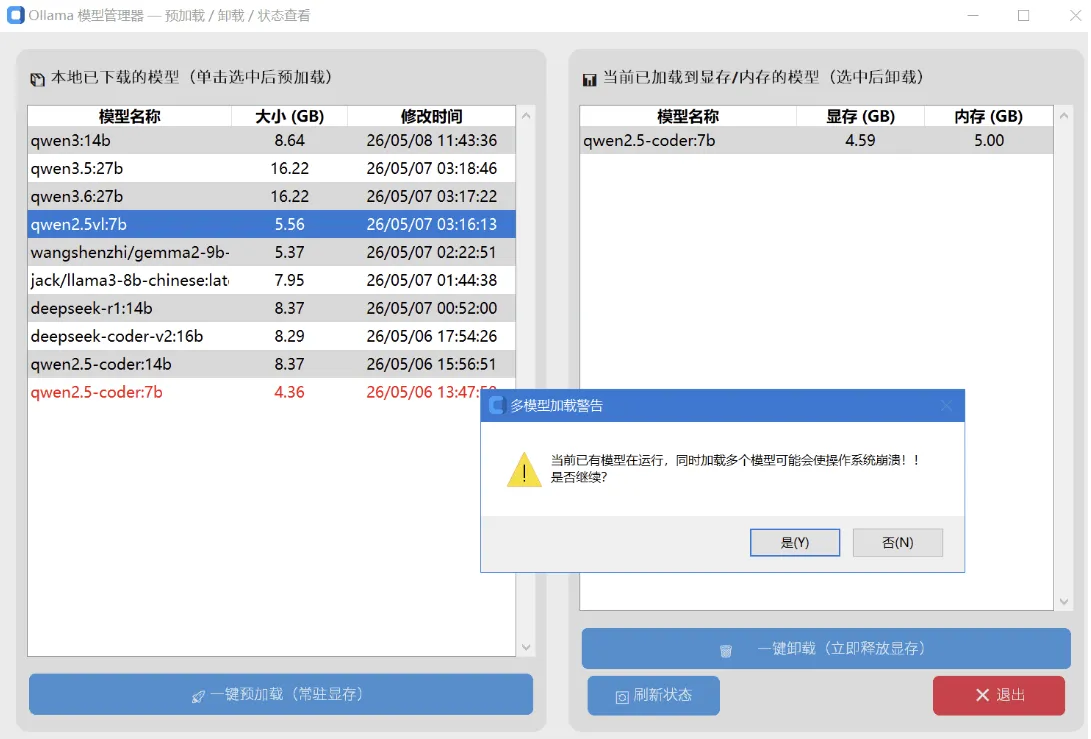

主要用来主动提前加载大模型,以节省首次和大模型交互的响应时间

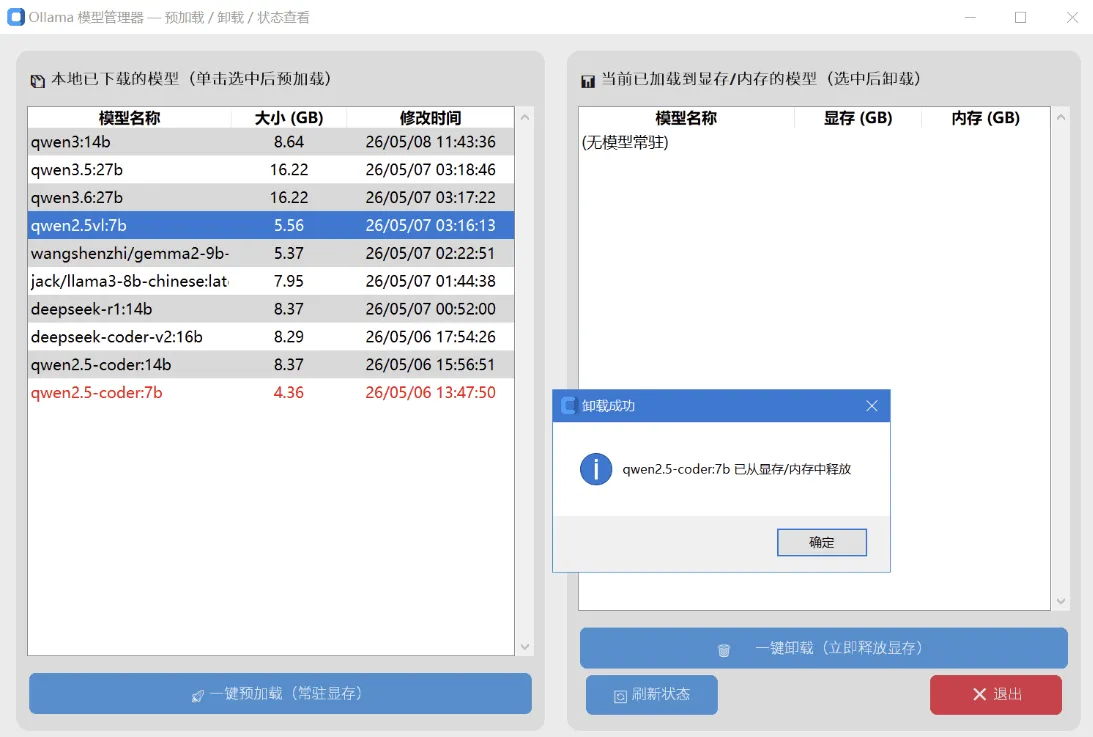

或者手动从显存中卸载大模型,以便快速释放显存

** 程序主要用于 Ollama 且基于默认的 11434 端口 **

其他大模型调试软件,或者非Ollama 默认端口的,请忽略!!

使用时注意点:

1. 需要 Ollama 主程序正常运行中;

2. 预加载大模型后还需要在交互客户端选择预加载的模型名称;

重申:本程序只时起到将模型提前载入显存或卸载出显存而已!!!

考虑到已经是手动操作了,就直接默认是 永久加载,再设闲置时效好像意义不大!!!

https://120439037.lanzoum.com/iqhne3p0j8xe

正文完